AI-agenter går raskt fra imponerende demoer til virkelige verktøy som kan handle på dine vegne, og OpenClaw er ett av navnene som har fått mye oppmerksomhet i denne bølgen. Du har kanskje også hørt den samme programvaren omtalt som Clawdbot eller Moltbot — navn utvikleren, østerrikske Peter Steinberger, brukte i forskjellige utviklingsfaser.

Markedsført som en personlig assistent uten direkte inngripen som kan betjene programvare for deg, reiser den samtidig viktige spørsmål om tilgang og sikkerhet.

- AI-agenter er handlingsdyktige AI-systemer, ikke bare samtaleverktøy.

- Verktøy som OpenClaw viser hvor kraftige selvhostede AI-agenter kan bli.

- Denne kraften introduserer nye sikkerhetsrisikoer når agenter behandler ukontrollert inndata.

- Promptinjeksjon er en sentral trussel mot AI-agenter — enda mer enn for chatbotter.

- Vedvarende minne kan forsterke feil og forlenge angrep.

- AI-agenter er kraftige, men ikke et trygt standardvalg for de fleste forbrukere.

Hva er hypen rundt OpenClaw?

OpenClaw får oppmerksomhet fordi det markerer et skifte fra AI som svarer på spørsmål til AI som aktivt kan utføre oppgaver i et ekte system og til og med bruke programvare. De potensielle sikkerhetsproblemene har også ført til at flere i sikkerhetsmiljøet diskuterer OpenClaw. Hva gjør OpenClaw attraktivt for utviklere og avanserte brukere?

OpenClaw skiller seg ut ved at det kan utføre reelle handlinger, ikke bare generere tekst eller forslag. I stedet for å fortelle deg hva du bør gjøre, kan det gjøre ting selv. Teknologien kan åpne apper, sende meldinger, flytte filer, kjøre kommandoer og samhandle direkte med systemer på dine vegne.

Det er denne graden av automasjon som vekker interesse. Utviklere og avanserte brukere ser systemkontroll som en måte å redusere repeterende arbeid eller automatisere arbeidsflyter. Tanken om en AI-agent som faktisk «gjør jobben» i stedet for bare å assistere fra sidelinjen, er et sterkt konsept.

Denne løfter om praktisk handlingskraft er grunnen til at OpenClaw raskt har gått fra et nisjeprosjekt til bredere diskusjon.

Hvorfor dette betyr noe utover OpenClaw

OpenClaw gir et synlig eksempel på et bredere skifte mot AI-agenter som faktisk handler, ikke bare svarer og gir råd.

Spørsmål om potensiell misbruk blir uunngåelige når denne typen teknologi vokser. Det OpenClaw viser, er hvor AI er på vei — og det gjør teknologien relevant langt utover ett prosjekt. Det setter også scenen for løpende diskusjoner om hvordan disse agentene bør kontrolleres. Kan de stoles på?

Hva er AI-agenter, og hva skiller dem fra andre AI-verktøy?

AI-agenter er systemer som ikke bare gir tekst- eller lydsvar på spørsmål. De kan planlegge trinn og utføre handlinger for å nå et mål. I stedet for å stoppe ved råd, bestemmer de hva som skal gjøres videre og utfører det.

En AI-agent kan observere en situasjon og iverksette handlinger. Dette skiller seg fra de fleste AI-verktøy, som svarer på forespørsler men venter på neste instruksjon. Tidlige eksempler inkluderer oppgavedrevne agenter som Manus (nå eid av Meta). Manus viser hvordan agenter kan bevege seg fra chat til handling — den kan utføre dataanalyse eller til og med skrive kode for å løse problemer uten å bli eksplisitt bedt om det. Det krever mindre menneskelig input.

OpenClaw bygger videre på samme idé om handlingsdyktig AI, men anvender den på en mer direkte og kraftfull måte.

Er OpenClaw en typisk AI-agent eller noe mer avansert?

OpenClaw faller inn under kategorien AI-agenter. Det tilbyr en kraftigere implementering enn mange av verktøyene folk flest kjenner til i dag.

Dette AI-verktøyet kan planlegge oppgaver og handle uten kontinuerlig inndata. OpenClaw kan samhandle direkte med programvare og operativsystemet, ikke bare med API-er eller begrensede verktøy. Den bredere tilgangen øker bruksmulighetene og skiller det fra andre løsninger. Samtidig øker det innsatsen og viktigheten av sikkerhet.

Hvorfor selvhostede AI-agenter er annerledes

Selvhostede AI-agenter kjører lokalt på ditt eget system i stedet for på en ekstern tjeneste. Dette gir brukerne mer kontroll over konfigurering og oppførsel — men det flytter også ansvaret.

Når en agent har lokal tilgang, avhenger sikkerheten av hvordan den er konfigurert, hvilke tillatelser den har, og hvordan den overvåkes. Mer kontroll gir mer risiko.

Nylige prosjekter viser hvordan idéen om «selvhostet» begynner å endre seg. For eksempel kan Moltbot (tidligere Clawdbot) nå kjøres ved hjelp av Cloudflares åpen kildekode Moltworker. Dette fjerner helt behovet for dedikert lokalt maskinvare ved å kjøre agenten på en administrert plattform i stedet.

Det senker terskelen og forenkler oppsettet, men det flytter også hvor kontrollen ligger. Når en agent kjører på skyinfrastruktur, avhenger sikkerheten ikke bare av agenten selv, men også av tilgangskontroller og hvordan data og rettigheter håndteres på tvers av plattformen.

For eksempel kan en bruker koble en AI-agent til e‑postkontoen sin i troen på at den bare skal lese meldinger, mens skyoppsettet også tillater at den sender e‑poster med mindre den spesifikke tillatelsen er deaktivert.

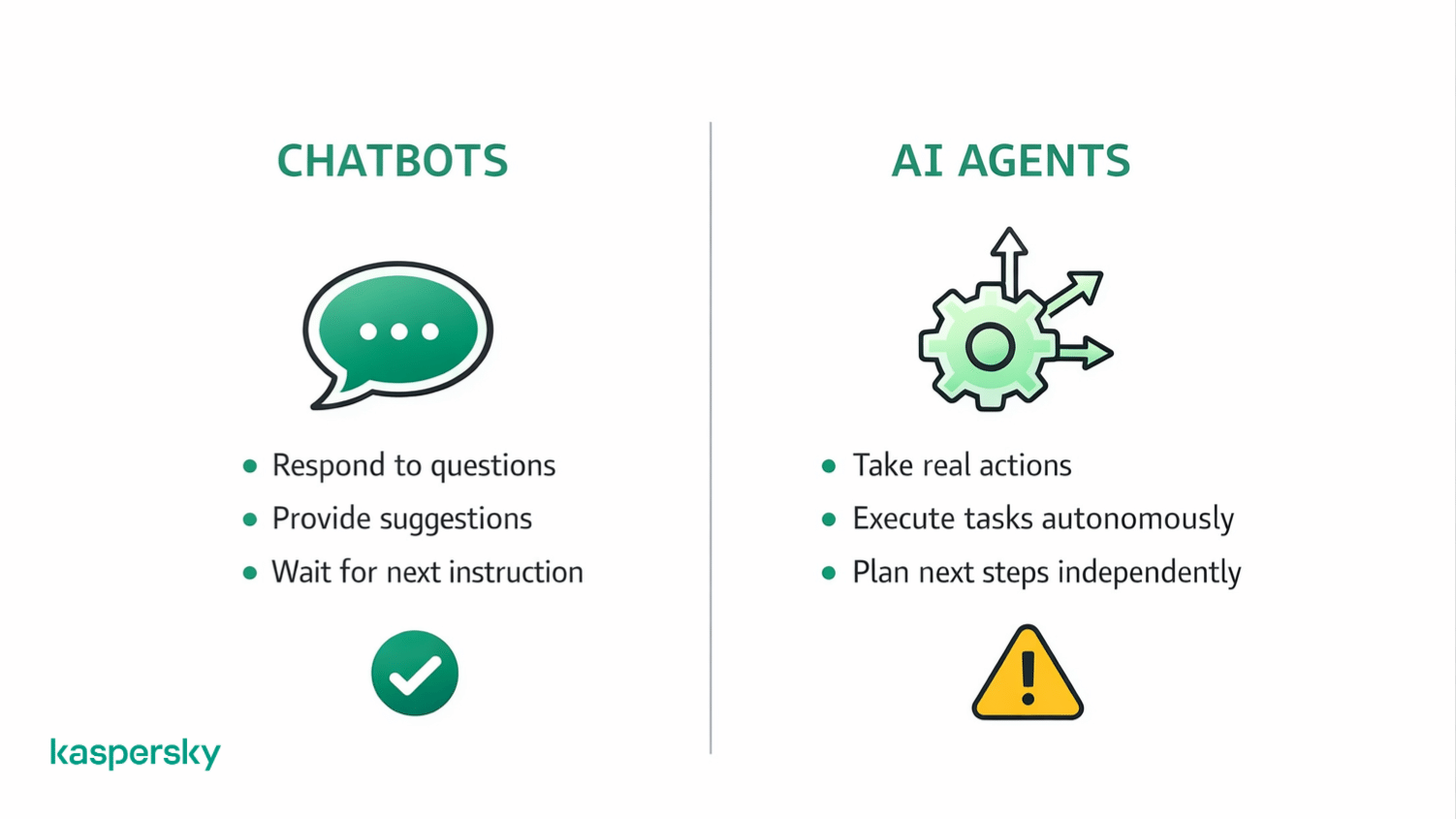

Hvordan skiller AI-agenter seg fra chatbotter som ChatGPT?

Chatbotter som ChatGPT svarer, mens AI-agenter handler.

En chatbot kan gi forslag eller forklaringer. En AI-agent kan aktivt åpne programmer eller gå gjennom arbeidsflyter.

Som eksempel har noen brukt OpenClaw for å automatisere trading. De har laget regler og bedt AI ikke bare om å gi råd (noe ChatGPT kunne gjort) men om å faktisk gjennomføre handler.

Hvorfor introduserer AI-agenter nye sikkerhetsrisikoer?

Som nevnt tidligere, utfører AI-agenter handlinger i stedet for bare å gi råd. Det innebærer ofte tilgang til filer, apper eller systemfunksjoner.

Systemtilgangen og autonomien som OpenClaw får, endrer både konsekvenser og risiko. OpenClaw vil be om tillatelse til å samhandle med programvare eller utføre handlinger som å sende e‑post eller fylle ut skjemaer uten din løpende overvåkning. Det gjør agenten til en joker.

Feil eller manipulering kan få reelle konsekvenser. Risikoen er ikke bare hva agenten blir bedt om å gjøre, men også hva den tolker som instruksjoner mens den utfører en oppgave.

Hvorfor ukontrollert inndata er et kjerneproblem

AI-agenter bruker store mengder eksternt innhold (som nettsider og dokumenter) for å avgjøre hva de skal gjøre videre. Slike kilder er ikke alltid pålitelige.

Instruksjoner trenger ikke være eksplisitte. De kan være skjult i tekst eller data agenten leser i løpet av en oppgave. Det gjør det mulig for angripere å påvirke en agents oppførsel uten å ha direkte kontakt med den.

Denne utfordringen åpner en klar vei til promptinjeksjon — der ukontrollert inndata brukes for å styre en agent til å utføre handlinger den aldri skulle ha utført.

Kraftige AI-verktøy krever sterkere beskyttelse

AI-agenter kan få tilgang til filer, e‑poster og systemfunksjoner. Kaspersky Premium hjelper med å oppdage mistenkelig aktivitet, blokkere skadelige skript og beskytte enhetene dine mot virkelige netttrusler.

Prøv Premium gratisHva er promptinjeksjon i AI-agenter?

Promptinjeksjon er en måte å manipulere en AI-agent på ved å gi den ukontrollert inndata som endrer hvordan den oppfører seg.

Risikoen handler ikke nødvendigvis om en teknisk feil i koden. Det er at agenten kan behandle eksterne innspill — som meldinger eller kommentarer — som instruksjoner. Når det skjer, kan agenten bli ledet til å utføre handlinger den aldri var ment å utføre.

Hvordan promptinjeksjon fungerer i praksis

Promptinjeksjon kan være direkte eller indirekte.

- Direkte – en angriper inkluderer bevisst instruksjoner i innhold agenten leser.

- Indirekte – agenten plukker opp skjulte eller uventede instruksjoner fra en nettside eller melding den prosesserer under normale oppgaver.

Kjernen i problemet er oppførsel. Agenten kan følge det den tolker som veiledning, selv om kilden er upålitelig. Det kreves ingen vanlig programvarefeil for at dette skal skje.

Hvorfor promptinjeksjon er farligere for AI-agenter enn for chatbotter

Injiserte instruksjoner påvirker vanligvis svar og råd fra chatbotter. For AI-agenter kan de derimot påvirke handlinger.

Hvis en agent har tilgang til filer eller systemkontroller, kan manipulerte instruksjoner føre til reelle endringer i den fysiske eller digitale hverdagen. Derfor utgjør promptinjeksjon en større risiko for agenter: den samme teknikken som endrer tekstoutput i en chatbot, kan utløse uønskede handlinger når en agent er involvert.

Hva er vedvarende minne i AI-agenter?

Vedvarende minne gjør at en AI-agent kan beholde informasjon over tid. Det betyr at den kan bruke tidligere innspill for å styre fremtidige avgjørelser i stedet for å starte fra null for hver oppgave.

Hva vedvarende minne betyr for AI-agenter

En AI-agent kan lagre kontekst og instruksjoner på tvers av økter og utvikle foretrukne «atferder». Dette hjelper agenten til å jobbe mer effektivt ved å huske hva den har lært eller gjort tidligere.

Det betyr også at tidligere input kan påvirke senere oppførsel. Instruksjoner eller antakelser hentet inn i en tidligere oppgave kan fortsatt forme hvordan agenten handler i en annen situasjon, selv om brukeren ikke lenger er klar over dem.

Hvorfor vedvarende minne øker sikkerhetsrisikoen

Vedvarende minne kan introdusere forsinkede effekter. En skadelig instruksjon gir kanskje ikke umiddelbare problemer, men kan dukke opp igjen senere når forholdene ligger til rette.

Dette gjør opprydding vanskeligere. Lagret atferd kan gjenta seg på tvers av oppgaver. For å gjenopprette et agentmiljø fullt ut kreves det ofte å slette minnet eller bygge opp konfigurasjoner på nytt for å sikre at uønsket påvirkning er fjernet.

Hva skjer når en AI-agent er feilkonfigurert eller eksponert?

En AI-agent kan nås eller påvirkes på måter eieren aldri hadde til hensikt, og forvandle et nyttig verktøy til en potensiell sikkerhetsrisiko.

Dette kan skje ved en ulykke eller misforståelse. Det kan også skje hvis tredjeparter forsøker å manipulere agenten.

Hvordan AI-agenter kan bli eksponert ved et uhell

Eksponering skjer ofte gjennom enkle feil. Noe så grunnleggende som svak autentisering eller for vide tillatelser kan gjøre en agent tilgjengelig fra utenfor dens tiltenkte miljø.

Å kjøre en agent lokalt gjør den ikke automatisk sikker. Hvis den kobles til internett eller samhandler med andre systemer, kan den påvirkes. Lokal kontroll reduserer noen risikoer, men fjerner dem ikke helt.

Hvorfor eksponerte AI-agenter blir angrepsflater

Når en agent er eksponert, blir den noe angripere kan undersøke, teste og manipulere. De kan forsøke å gi den spesiallaget inndata, trigge handlinger eller kartlegge hvordan den oppfører seg over tid.

Fordi agenter kan utføre reelle handlinger, trenger ikke misbruk å se ut som et tradisjonelt angrep. Misbruk kan innebære å styre atferd, hente ut data eller forårsake utilsiktede systemendringer — alt uten å utnytte en klassisk programvarefeil.

Hva er «den dødelige trefoldigheten» i sikkerhet for AI-agenter?

«Den dødelige trefoldigheten» beskriver tre forhold som samlet skaper alvorlig sikkerhetsrisiko for AI-agenter.

De tre betingelsene som muliggjør alvorlige angrep

- Den første betingelsen er tilgang til sensitive opplysninger, som filer, legitimasjon eller intern informasjon.

- Den andre er ukontrollert inndata — agenten konsumerer innhold den ikke fullt ut kan verifisere.

- Den tredje er evnen til å utføre eksterne handlinger, som å sende forespørsler, endre systemer eller kjøre kommandoer.

Hver for seg kan disse faktorene være håndterbare. De blir farlige når de samvirker som denne trefoldigheten. En agent som leser ukontrollert inndata og kan handle på det, skaper en klar vei for manipulasjon. Å kontrollere hvilke handlinger en agent får lov til å utføre er avgjørende.

Bør vanlige brukere kjøre AI-agenter i dag?

For de fleste er AI-agenter fortsatt eksperimentelle verktøy. De kan være nyttige i riktig miljø. Ulempen? De introduserer også nye risikoer som ikke alltid er åpenbare.

Når det kan være fornuftig å bruke en AI-agent

En AI-agent kan gi mening i kontrollerte og lavrisiko-scenarier. Det inkluderer å eksperimentere på en separat enhet. Noen kjører agenter som bare håndterer ikke-sensitive oppgaver som å organisere filer eller teste arbeidsflyter.

Si at du vil bruke agenten til å lage en reiserute for en kommende tur. Den kan få tilgang til nødvendig informasjon for dette, samtidig som du forhindrer at den kontakter personer direkte eller gjør noe skadelig.

Hvis du er komfortabel med å styre innstillinger og konsekvensene av feil ikke er «høyrisiko», kan en agent være et læringsverktøy. Nøkkelen er å holde omfanget begrenset og tilgangen stramt kontrollert.

Når AI-agenter er en dårlig idé

AI-agenter passer dårlig hvis de har tilgang til sensitive data eller viktige kontoer. Å kjøre agenter uten å forstå tillatelser eller farene ved eksterne innspill øker risikoen raskt.

Det er også helt greit å velge bort. Å la være å kjøre en AI-agent i dag er et fornuftig valg hvis bekvemmelighet går på bekostning av sikkerhet eller trygghet.

Hvilke grunnleggende sikkerhetstiltak er essensielle når du bruker AI-agenter?

Grunnleggende sikkerhetstiltak reduserer risiko og hindrer at små feil utvikler seg til alvorlige problemer.

Kasperskys programvare kan legge et ekstra beskyttelseslag ved å varsle om mistenkelig oppførsel og hjelpe med å beskytte kontoer mot kompromittering. Våre pakker blokkerer alt fra skadelig programvare og virus til løsepengevirus og spionapper.

Hvilke sikkerhetstiltak betyr mest

Isolasjon er nøkkelen. Kjør agenter på separate enheter og kontoer når det er mulig, slik at de ikke påvirker viktig data eller systemer. Begrens tillatelser til kun det agenten faktisk trenger. Vi anbefaler at du unngår å gi full system- eller kontotilgang som standard.

Bekreftelsestrinn er også viktige. Å kreve godkjenning før sensitive handlinger gir en pause som kan hindre utilsiktet oppførsel — for eksempel at agenten bruker penger på dine vegne. Disse enkle kontrollene har stor effekt uten å gjøre ting unødvendig komplisert.

Hva betyr AI-agenter for fremtiden til forbrukerrettet AI?

AI-agenter peker mot en fremtid der AI-verktøy gjør mer enn å assistere — de handler. Men dette skiftet kommer med avveininger som forbrukere først nå begynner å navigere.

Hva dette øyeblikket forteller oss om modenheten til AI-agenter

AI-agenter er kraftige, men umodne. De kan automatisere oppgaver, men sliter fortsatt med elementer av dømmekraft og sikkerhet. Det betyr ikke at agentene ikke kan bli tryggere eller mer pålitelige. Det betyr at forventningene bør være realistiske.

AI-agenter viser hvor ting er på vei, men utbredt, daglig bruk krever bedre sikkerhetsmekanismer og verktøy som er designet med sikkerhet i fokus fra starten av.

Relaterte artikler:

- Hvordan adresserer ChatGPT cybersikkerhetsbekymringer og potensielle risikoer?

- Hva er risikoene ved AI-drevet nettkriminalitet i dagens digitale landskap?

- Hvordan forbedrer AI og maskinlæring cybersikkerhetstiltak?

- Hva er farene ved deepfake-teknologi i dag?

Anbefalte produkter:

FAQs

Er OpenClaw gratis å laste ned?

OpenClaw kan lastes ned fritt på GitHub. Det er åpen kildekodeprogramvare. Det betyr at flere kan endre og distribuere programvaren videre.

Er OpenClaw enkelt å sette opp?

Det finnes veiledninger som får folk i gang med bots raskt, men et mer sofistikert oppsett krever tid og spesialistkompetanse. Det er nettopp derfor det er risikabelt å kjøre programvare som kanskje ikke er riktig konfigurert.